Nuestros datos en manos de las IA

Cada vez que interactuamos con dispositivos que usan inteligencia artificial (IA) estamos proporcionando datos que, si bien se utilizan para mejorar los servicios que se ofrecen a través de ese dispositivo, también podrían ser utilizados o manipulados con intenciones ajenas a nuestro interés.

La IA funciona a partir de los muchos datos e instrucciones que se le ingresan. Por ejemplo: cuando una persona ve videos en Youtube, le comienzan a aparecer recomendaciones acordes a los temas y géneros que ha visto. ¿Por qué? Porque ya existe una programación para que la plataforma registre lo que vemos, por cuánto tiempo, con qué frecuencia, etcétera, y, a partir de ello y de acuerdo con las bases de datos e instrucciones que posee, recomienda.

Es más, podría ser que en las instrucciones esta plataforma tenga indicado, por ejemplo, «Priorizar videos de tal o cual empresa», o de «tal o cual película» o, simplemente, «priorizar los que tengan más “me gusta”»; de modo que los resultados que nos brinde una IA pueden estar interesados en favor del beneficio económico o político de alguien. No se trata de ver a la IA como un «diablo» o una amenaza, sino de comprender sus alcances y aprender a sacar el mejor provecho de ella.

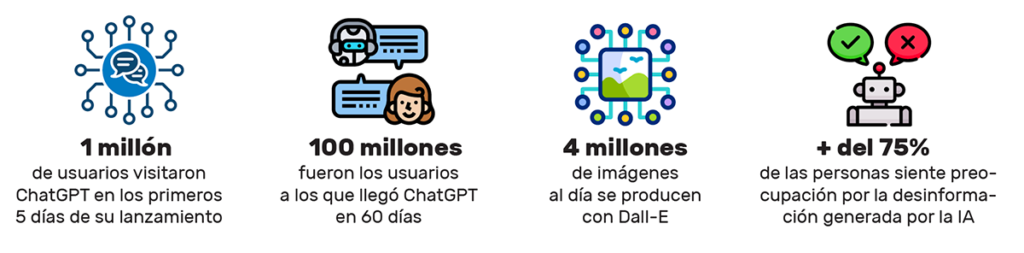

Las diferentes IA (ChatGPT, Gemini, DeepSeek, etc.) se están actualizando constantemente con más y más datos, los cuales integran a sus respuestas. Aquí no hay intuición, imaginación o magia: es procesamiento de información, y va en expansión. Según datos de Forbes, se espera que este año (2025) alrededor de 378 millones de personas utilicen la IA de forma regular (Forbes). Chicos.net ofrece las siguientes cifras:

Fuente: Chicos.net (https://www.chicos.net/inteligencia-artificial). Iconos: Noun Project

Es importante que nuestros hijos o estudiantes aprendan que la IA no es «como una persona, pero en máquina», ni tampoco es «algo que lo sabe todo» o que «es infalible», pues se inventa información y, en ocasiones, se equivoca mucho.

Cuando explicamos la IA a nuestros hijos pequeños o estudiantes, podemos decirles que es como un «asistente» que ha leído muchos libros, periódicos y revistas, y anota todo lo que hacemos y todo lo que sucede, con el objetivo de dar respuestas y soluciones más acertadas. Por ejemplo, detecta patrones: después del desayuno viene el almuerzo, por la mañana temprano las personas piden ciertos platillos y a medio día piden otros; por lo tanto, a determinadas horas sugerirá un menú y a otras horas otro.

Aunque estamos utilizando IA desde hace más de una década, el auge de la misma es relativamente nuevo, pues en el pasado no era accesible tan masivamente como en la actualidad, que hay aplicaciones gratuitas y pagadas para usarla. (ChatGPT salió el 30 de noviembre de 2022, hace menos de tres años).

La inteligencia artificial no decide sola, sigue unas indicaciones, por lo tanto, si se le «enseñan» cosas negativas o positivas, las replicará.

En la investigación «Llegada de la IA a América Latina: en construcción» (2025, OEI y Fundación Pro Futuro https://n9.cl/rwq9o) se señalan algunos riesgos, por ejemplo, la deshumanización de la educación, cuando quieran confiarse los procesos educativos a seminarios «online» dictados por IA; la falta de acceso igualitario a la IA, debido a que haya que pagar por ella.

La educación no es «llenar con información» las cabezas de los estudiantes, por eso una IA robótica no es suficiente. La educación incluye la convivencia en la escuela con personas más o menos diferentes e implica tener acceso a figuras que sirven como ejemplo en la vida diaria, entre las cuales los docentes son una de las que tienen más peso.

Especial mención merece el riesgo de invasión a la privacidad de los niños y de las familias, dado que al interactuar en los dispositivos con aplicaciones que tengan IA incorporada, puede que esta acceda a datos sensibles como la ubicación física, las costumbres, el nivel socioeconómico y otros datos que ninguno de nosotros haría públicos así porque sí.

La IA es solo una tecnología creada y programada por las personas, por lo tanto puede ser utilizada para el bien o para el mal. Por ejemplo, un encendedor, lo podemos usar para encender la cocina de gas y hacer la comida, o para quemar una casa. Si a un sistema de IA se le programa para hacer cosas negativas, las hará, y viceversa.

Todos deberíamos aprender que, si utilizamos IA, debería ser para ayudar, no para hacer trampas o dañar a un familiar, a un novio o novia o a un compañero de la escuela. Es por eso que se afirma que una buena IA depende de que haya buenos humanos.

En síntesis: la inteligencia artificial no decide sola, sigue unas indicaciones, por lo tanto, si se le «enseñan» cosas negativas o positivas, las replicará; puede utilizarse para ayudar y también para dañar; todo lo que hacemos en los dispositivos es información que la IA almacena.